O problema que você conhece

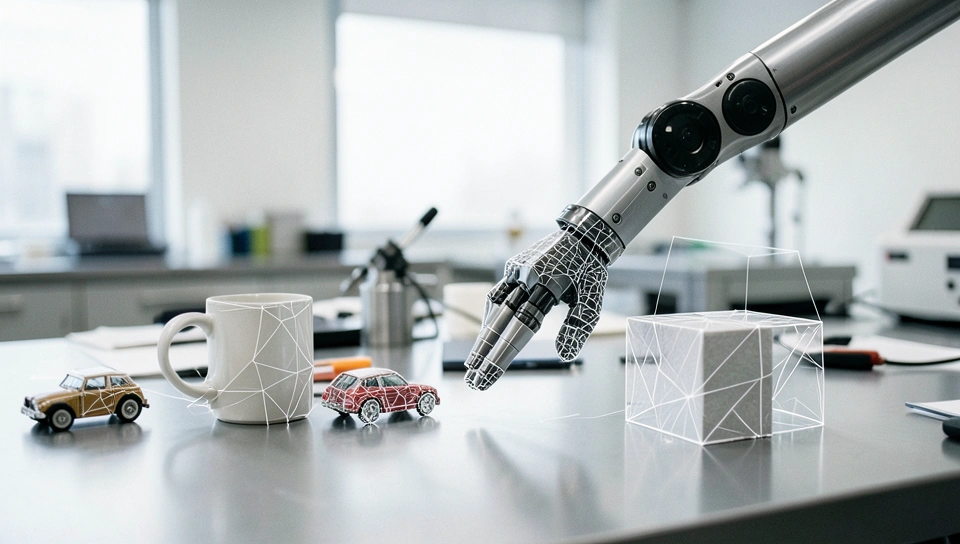

Você já tentou reconstruir uma cena 3D com poucas imagens e se deparou com artefatos, objetos faltando ou poses completamente erradas. É um gargalo clássico em robótica e simulação: sem uma reconstrução precisa, o robô não consegue planejar movimentos ou interagir com o ambiente de forma confiável. Agora, um time de pesquisadores propôs o RecGen, um framework generativo que promete resolver isso com um toque de inteligência.

O que é o RecGen

RecGen é um modelo generativo que, a partir de uma ou várias imagens RGB-D, estima formas, poses e texturas de múltiplos objetos em uma cena, mesmo com oclusões severas. Ele foi apresentado em um artigo do arXiv (2604.27106) e já alcança estado da arte em qualidade geométrica (30,1% melhor que o SAM3D), reconstrução de textura (9,1% melhor) e estimação de pose (33,9% melhor) — tudo isso usando 80% menos malhas de treinamento.

Como funciona na prática

Para quem opera modelos de visão computacional, o RecGen é essencialmente um gerador condicionado. Ele usa um pipeline de duas etapas: primeiro, um módulo de difusão gera uma representação latente da cena completa a partir das observações esparsas; depois, um decodificador neural extrai forma, pose e textura de cada objeto. A arquitetura provavelmente envolve transformers para agregar informação espacial e convoluções 3D para a saída volumétrica. Não há dados de latência ou custo computacional divulgados, mas o uso de 80% menos dados sugere que o modelo é eficiente em termos de amostras — algo que pode se traduzir em menos tempo de coleta e anotação para projetos reais.

O que isso muda na prática

Se você trabalha com simulação robótica, este artigo é um sinal claro: a reconstrução de cenas a partir de poucas views está se tornando viável. Isso significa que, em vez de escanear um ambiente com 50 câmeras, você pode usar 3 ou 4 imagens e obter um modelo 3D utilizável para treinar políticas de controle. A ação prática imediata: teste o RecGen (eles prometem código futuro) em cenários de oclusão pesada, como prateleiras de depósito ou mesas de cirurgia, onde objetos se sobrepõem. Quem ganha? Times de robótica que precisam de simulações realistas sem gastar horas capturando dados. Quem perde? Métodos que dependem de múltiplas vistas densas, como NeRF, podem perder espaço em aplicações com restrição de sensor.

Será que escala?

Uma dúvida que fica: o RecGen depende de um prior de forma 3D forte, construído a partir de geração sintética de cenas. Até que ponto esse prior generaliza para objetos nunca vistos? O artigo mostra resultados impressionantes em datasets com objetos comuns, mas o salto para ambientes industriais com peças metálicas reflexivas ou objetos deformáveis ainda é incerto. Além disso, o custo de inferência em tempo real para um robô navegando pode ser proibitivo. Resolve o problema de reconstrução, mas pode simplesmente mover o gargalo para a etapa de geração de priors.

Conclusão

RecGen é um avanço sólido que prova que modelos generativos podem superar abordagens discriminativas com muito menos dados. Se você está montando um pipeline de simulação, fique de olho — mas não esqueça de testar os limites da generalização. A pergunta que fica: seu robô consegue esperar os segundos de inferência ou você precisa de algo mais rápido?

Fonte: arXiv:2604.27106

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário