Quem já tentou rodar um LLM em um Raspberry Pi sabe: a memória acaba antes do modelo carregar. O Pi 5 com 16 GB ajuda, mas o custo sobe e a latência atrapalha. Agora, a Raspberry Pi Foundation lançou o AI HAT+ 2, com 8 GB de RAM onboard e 40 TOPS de inferência via acelerador Hailo-10H. A promessa é rodar modelos de linguagem e visão localmente, sem depender da nuvem. Mas será que isso muda o jogo ou é só um brinquedo caro?

O Fato

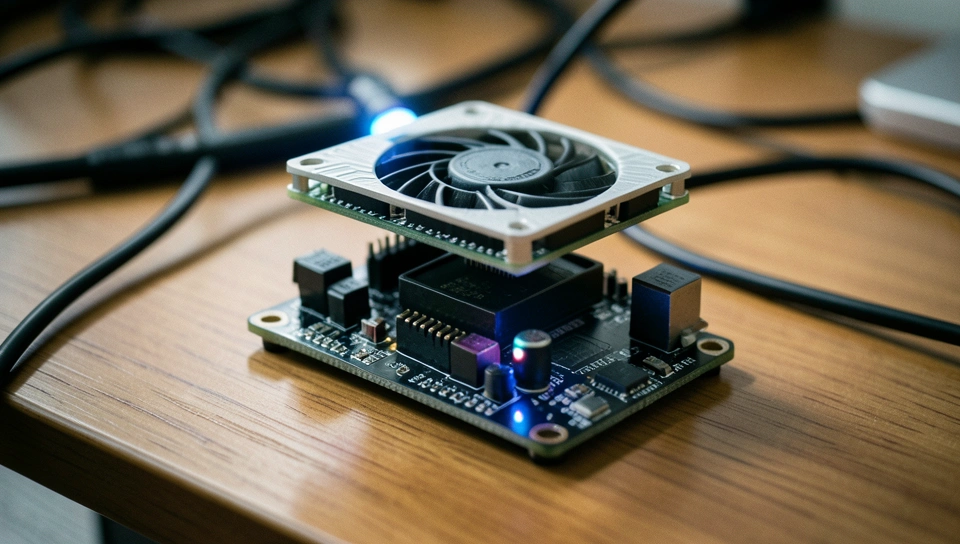

O AI HAT+ 2 é um HAT que se conecta ao GPIO do Pi 5 e se comunica via PCIe. Ele oferece 40 TOPS (INT4) para inferência de LLMs, VLMs e outras IAs generativas. A placa tem 8 GB de RAM dedicados, um dissipador passivo opcional (mas necessário, porque esquenta) e parafusos para fixar no Pi 5 com cooler ativo. O hardware custa US$ 130 e já está disponível. Na prática, você instala um Raspberry Pi OS atualizado, usa Docker e o servidor hailo-ollama para rodar modelos como Qwen2, Llama3.2, DeepSeek-R10-Distill e outros. Testei com o Qwen2 de 1,5 bilhões de parâmetros e funcionou sem travamentos.

Como Funciona (Visão de Operador)

O Hailo-10H é um chip de inferência que comunica via PCIe Gen 3 x1. Os 40 TOPS são em INT4; em INT8, provavelmente cai pela metade. A memória onboard de 8 GB é crucial: evita que o modelo consuma a RAM do Pi, que varia de 1 GB a 16 GB. Com 8 GB dedicados, você consegue rodar modelos de até ~4-5 GB com folga para o sistema. O software é simples: instalar o pacote hailo-ollama via apt, baixar a imagem Docker e apontar para o modelo. A latência vai depender do modelo – com 1,5B parâmetros, a resposta é quase instantânea no Pi 5; com modelos maiores, pode ficar lento. O consumo de energia é maior que o Pi sozinho, mas ainda baixo comparado a um desktop.

Comparação com o modelo anterior

O AI HAT+ original oferecia 26 TOPS (INT4) só para visão computacional. O novo modelo mais que dobra a capacidade de inferência e adiciona suporte a LLMs. Para visão, o ganho é pequeno (os mesmos 26 TOPS na prática, segundo a documentação). Quem já tinha o modelo anterior e só precisa de visão não precisa trocar. Para LLMs, a diferença é grande.

O Que Isso Muda na Prática

Quem ganha: makers que querem rodar chatbots locais sem depender de nuvem, aplicações de IoT que exigem processamento de linguagem natural na borda, e entusiastas de privacidade que não querem enviar dados para servidores externos. Quem perde: quem esperava rodar modelos grandes localmente – 8 GB não são suficientes para Llama3 8B, por exemplo. A Raspberry Pi Foundation afirma que modelos maiores virão em atualizações, mas não especifica quais. Ação prática: se você precisa de LLM local no Raspberry Pi, compre o AI HAT+ 2. Se for só visão, fique com o anterior ou a câmera AI de US$ 70.

Tensão / Reflexão

8 GB de RAM onboard é pouco para IA generativa. Modelos de 7B já precisam de pelo menos 8 GB só para os pesos, sem contar overhead. A solução da Raspberry Pi de permitir usar a RAM do Pi 5 (que pode ser de 16 GB) é um paliativo, mas aí o gargalo volta a ser o barramento PCIe e a latência. Será que o AI HAT+ 2 realmente resolve o problema de memória ou apenas empurra o gargalo para outro lugar? Além disso, o preço de US$ 130 soma-se aos US$ 80 de um Pi 5 com 8 GB, totalizando US$ 210 – o suficiente para comprar um mini PC usado com mais capacidade. Vale a pena?

Conclusão

O AI HAT+ 2 é um passo interessante para democratizar IA local em hardware de baixo custo, mas ainda é limitado. Roda modelos pequenos bem, mas não espere rodar GPT-4. Se você precisa de processamento de linguagem natural na borda e tem orçamento apertado, vale testar. Caso contrário, um mini PC ou uma GPU de entrada ainda são opções mais versáteis. No final, fica a pergunta: a borda realmente precisa de LLM ou é melhor continuar usando a nuvem?

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário