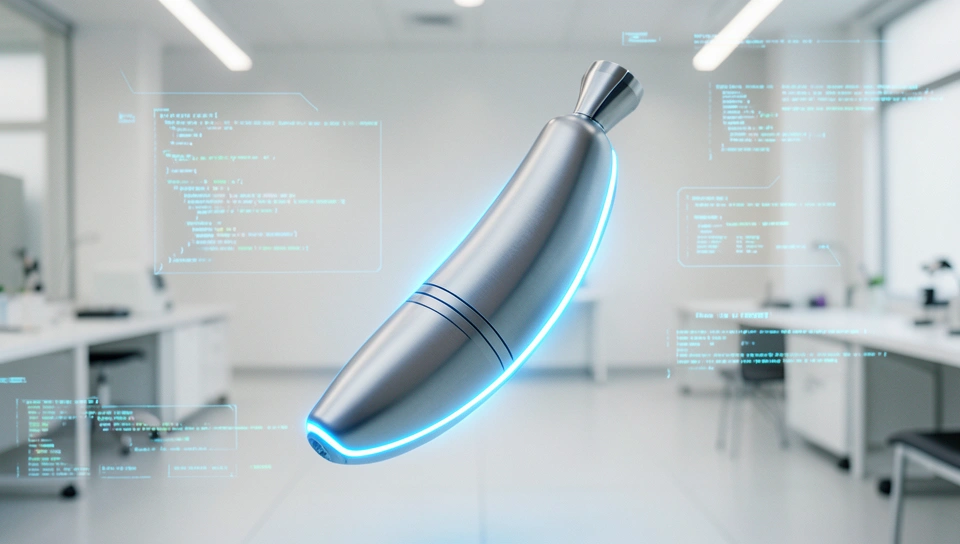

Se você já tentou gerar uma imagem com consistência de assunto em segundos, sabe o gargalo: modelos rápidos como Stable Diffusion sacrificam detalhes, enquanto os de qualidade como Midjourney demoram. DeepMind acabou de anunciar o Nano Banana 2, que promete unir capacidades Pro com velocidade Flash. A pergunta que fica: entrega ou é só marketing?

O que é o Nano Banana 2

O Nano Banana 2 é um modelo de geração de imagem desenvolvido pela DeepMind (Google). Ele se baseia no sucesso da versão anterior e adiciona conhecimento de mundo, specs profissionais e consistência de assunto. O principal diferencial é a velocidade: o modelo opera em 'Flash speed', termo que sugere latência muito baixa, provavelmente na casa de segundos ou menos.

Como funciona na visão de operador

Embora a DeepMind não tenha divulgado detalhes de arquitetura, é seguro inferir que o Nano Banana 2 usa uma combinação de transformer e difusão latente, otimizada para inferência rápida. O conhecimento de mundo provavelmente vem de um modelo de linguagem integrado, que entende contexto além de texto simples. Para consistência de assunto, deve usar técnicas de condicionamento com embeddings de rosto ou objeto. Em termos de custo, o Flash speed sugere que a execução é otimizada para GPUs modernas, possivelmente TPUs do Google, o que pode reduzir o custo por geração comparado a modelos que exigem múltiplas etapas de refinamento.

O que isso muda na prática

Para quem trabalha com criação de conteúdo, isso é um avanço real. Poder gerar imagens com qualidade profissional em segundos elimina a necessidade de esperar minutos por refinamentos. Quem ganha: designers que precisam de protótipos rápidos, equipes de marketing que geram variações de campanha, e desenvolvedores que integram geração em tempo real em aplicativos. Quem perde: modelos que priorizam qualidade extrema sobre velocidade, como versões antigas de DALL-E ou Midjourney em modo lento. Uma ação prática: se você usa geração de imagem, teste o Nano Banana 2 via API do Google Cloud Vertex AI; configure o prompt com consistência de assunto usando imagens de referência.

Tensão e reflexão

A grande questão é: a consistência de assunto é realmente consistente em múltiplas gerações? Modelos rápidos tendem a ter variabilidade alta. Se o Nano Banana 2 sacrifica fidelidade por velocidade, pode não ser adequado para tarefas que exigem precisão, como gerar o mesmo personagem em várias poses. Outro ponto: o custo real por chamada de API ainda não foi divulgado. Se for caro demais para escala, o Flash speed perde o sentido. Será que a DeepMind resolveu o trade-off ou apenas moveu o gargalo para outro lugar?

Conclusão

O Nano Banana 2 parece um passo importante para democratizar a geração de imagem de alta qualidade, mas a prova real será no uso cotidiano. Se a consistência e o custo se provarem viáveis, pode se tornar a referência para aplicações em tempo real. Fica a pergunta: você está disposto a trocar um pouco de qualidade por muito mais velocidade? A decisão depende do seu caso de uso.

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário