O problema real da memorização

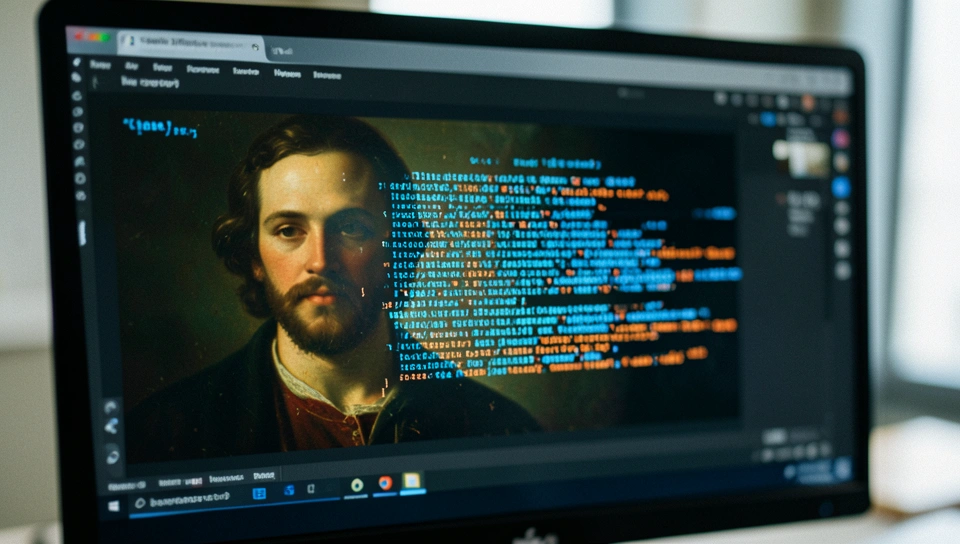

Você já gerou uma imagem no Stable Diffusion e, sem querer, saiu algo idêntico a uma foto famosa? Isso não é coincidência. Modelos de texto para imagem tendem a memorizar exemplos do treinamento, o que gera riscos de copyright e vazamento de dados. Até agora, a culpa era atribuída ao modelo de difusão em si. Mas um novo artigo no arXiv vira essa chave: o verdadeiro responsável são os embeddings do CLIP.

O fato

Pesquisadores descobriram que a memorização no Stable Diffusion é impulsionada de forma inesperada pelos embeddings de texto do CLIP, e não pelo processo de difusão. Eles categorizam os tokens de entrada em Start-of-Text, Prompt, End-of-Text e Padding, e mostram que os embeddings de padding, que duplicam estruturalmente o embedding de End-of-Text, amplificam sua influência, levando à memorização. Duas estratégias simples de mitigação são propostas: substituir o caractere de padding por '!' e mascarar o embedding de End-of-Text, ou mascarar parcialmente os embeddings de padding.

Como funciona na prática (visão de operador)

Em termos de arquitetura, o Stable Diffusion recebe um prompt textual que passa pelo CLIP text encoder, gerando embeddings para cada token. Os embeddings de padding são repetições do embedding de End-of-Text, que é o único explicitamente otimizado durante o treinamento do CLIP. Essa repetição cria uma amplificação não intencional, fazendo o modelo de difusão se apoiar demais nesse embedding, resultando em memorização. A inferência acontece com custo extra mínimo: trocar o token de padding e mascarar um embedding é trivial, sem aumentar latência. As estratégias não exigem re-treino ou detecção prévia, podem ser aplicadas como pós-processamento.

O que isso muda na prática

Quem ganha são desenvolvedores que usam Stable Diffusion e querem evitar problemas legais. Agora, eles podem aplicar uma mitigação simples para reduzir memorização sem degradar qualidade das imagens. Quem perde? Talvez quem depende de gerar imagens que copiem intencionalmente estilos protegidos – essa não é uma prática desejável, de qualquer forma. Ação prática: se você usa Stable Diffusion, implemente a substituição do padding token por '!' e o masking do embedding de End-of-Text. Teste em seus casos de uso típicos; a qualidade deve se manter, mas a memorização cai.

O gargalo da scalabilidade

A dúvida que fica: essa descoberta escala para outros modelos de difusão, como DALL-E ou Midjourney? O mecanismo depende da arquitetura do CLIP, que é comum em muitos sistemas. Mas pode ser que outros modelos tenham suas próprias peculiaridades. Além disso, a mitigação resolve a memorização, mas não elimina completamente o risco de reprodução de conteúdo de treinamento – apenas reduz.

Tensão real: vale a pena?

Trocar o padding e mascarar um embedding é tão simples que não há desculpa para não fazer. Mas isso resolve o problema de raiz? Não completamente. A memorização tem múltiplas causas, e este paper ataca apenas uma delas. O que acontece quando o modelo começa a memorizar por outros caminhos? Por enquanto, é um avanço prático e imediato. A reflexão é: em vez de forçar o modelo a esquecer, talvez precisemos repensar como o CLIP é treinado para evitar essa amplificação desde o início.

Conclusão

O CLIP não era apenas um encoder de texto inofensivo – ele é a porta de entrada para a memorização no Stable Diffusion. Com duas alterações mínimas na inferência, você reduz o risco de gerar cópias não intencionais. A pergunta que fica: quantos outros artefatos estão escondidos nos componentes que consideramos seguros?

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário