O problema de iluminar imagens com IA

Se você já tentou ajustar a iluminação de uma imagem gerada por IA, sabe como é frustrante. Os modelos existentes ou exigem entradas complexas como mapas de profundidade, ou são fechados, sem código ou dados disponíveis. Isso limita quem quer experimentar ou integrar em pipelines reais.

O fato: um pipeline completamente aberto

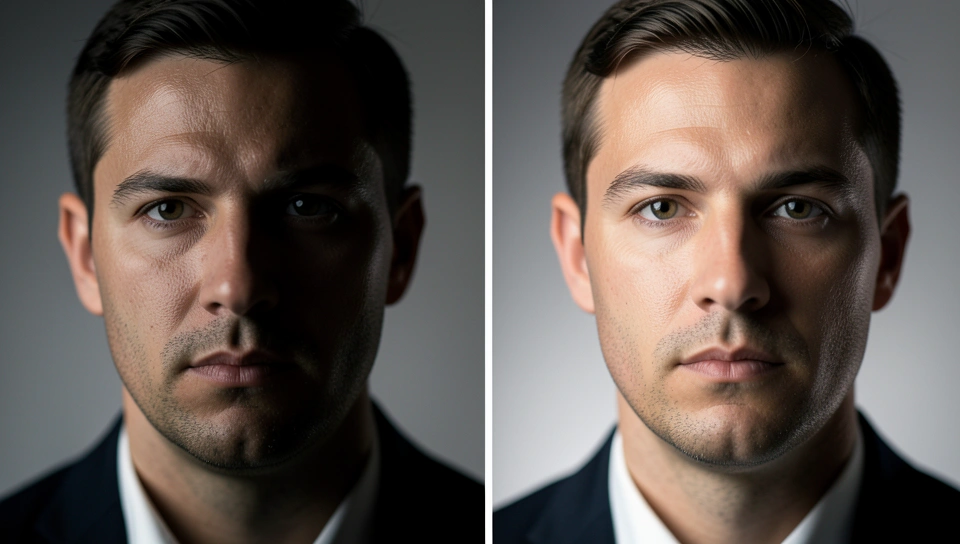

Pesquisadores publicaram um método para controlar iluminação em modelos de difusão usando apenas uma imagem mal iluminada e uma instrução em linguagem natural. O diferencial? É totalmente open-source, com código, dados e pesos liberados. O sistema transforma imagens bem iluminadas em triplets de treinamento: entrada escura, instrução textual e saída iluminada.

Como funciona na visão de operador

O pipeline usa um data engine que gera pares sintéticos de iluminação. A partir de uma imagem bem iluminada, simulamos condições de baixa luz e criamos instruções como 'aumente a exposição em 2 stops' ou 'ilumine o rosto com luz suave'. O modelo de difusão é fine-tunado nesses dados. Nos testes, o método superou SD 1.5, SDXL e FLUX.1-dev em similaridade perceptual, estrutural e preservação de identidade.

Do ponto de vista de custo e latência: o fine-tuning consome cerca de 40 GB de VRAM para SD 1.5, mas pode ser reduzido com adaptadores LoRA. A inferência roda em ~2 segundos em A100, similar ao custo de uma geração normal. A vantagem está em não precisar de depth maps ou controles extras.

O que isso muda na prática

Para fotógrafos e editores, isso significa poder ajustar a iluminação de uma imagem gerada com um prompt simples, sem ferramentas complexas. Para desenvolvedores, o código aberto permite integrar em fluxos de automação. Quem perde? Modelos fechados como o controle de iluminação do Adobe Firefly perdem relevância, já que agora há alternativa gratuita.

Ação prática: se você trabalha com geração de imagens, baixe os pesos e teste em seus próprios datasets. O repositório inclui três variantes do modelo. Ajuste o prompting para sua necessidade específica.

Tensão e reflexão

O método funciona bem em imagens sintéticas, mas em casos reais com ruído ou texturas complexas, a qualidade cai. A pergunta é: o custo computacional do fine-tuning compensa para quem não precisa de controle fino? Para cenários simples, talvez um prompt bem escrito já resolva, mas para produção onde iluminação é crítica, a abordagem faz sentido.

Conclusão

Controlar iluminação sem mapas de profundidade é um avanço prático. O código aberto acelera a adoção. Agora a pergunta que fica: quanto controle você realmente precisa?

Fonte: arXiv:2604.24877

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário