O problema de achar que linguagem basta

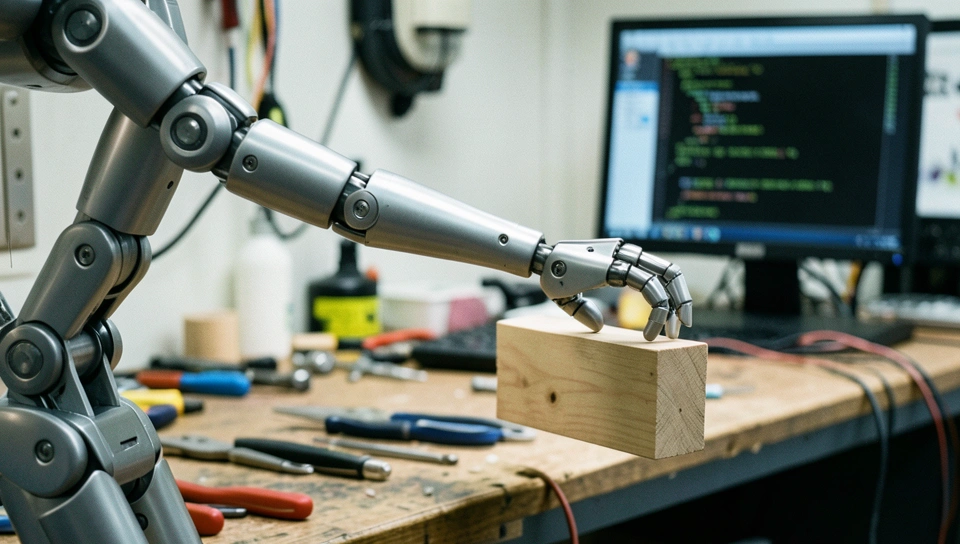

Você já bateu de frente com um modelo de linguagem que parece entender tudo, mas na hora de aplicar o conhecimento num problema real, falha feio? A sensação é familiar. O artigo 'AGI Is Not Multimodal', do Gradient, cutuca exatamente essa ferida: estamos confundindo fluência verbal com inteligência genuína. A citação de Terry Winograd abre o texto de forma certeira: 'Ao projetar a linguagem de volta como modelo do pensamento, perdemos de vista a compreensão tácita incorporada que sustenta nossa inteligência.' Isso ressoa com qualquer operador que já tentou usar um LLM para controlar um braço robótico ou interpretar um gráfico complexo sem texto associado.

O fato: um artigo que questiona o dogma multimodal

O texto do Gradient não é uma notícia, é um ensaio crítico. Ele argumenta que os recentes avanços em modelos multimodais (que combinam texto, imagem, áudio) ainda não capturam a essência da inteligência geral. A tese central: AGI não será alcançada apenas processando múltiplas modalidades de dados sensoriais; é preciso algo mais fundamental – a compreensão tácita que vem da experiência incorporada, do corpo em ação. Winograd, referência em IA desde os anos 1970, dá peso ao argumento. Para quem constrói sistemas, isso não é só filosofia: tem implicações diretas no design de agentes autônomos.

Como funciona: a lacuna entre token e ação

Na prática, um modelo multimodal típico recebe entradas de diferentes tipos (texto, imagem, áudio) e as transforma em embeddings que alimentam um transformer. A arquitetura é padronizada: codificadores separados para cada modalidade, depois um mecanismo de atenção cruzada para alinhar representações. O custo computacional escala com o número de modalidades – latência adicional, maior uso de GPU, necessidade de datasets enormes e balanceados. Mas o gargalo não é apenas técnico: mesmo com dados perfeitamente alinhados, o modelo não tem um corpo. Ele não sabe o que é levantar um copo, sentir o peso, ajustar a força. A compreensão tácita, que um bebê aprende ao explorar o mundo, não está nos tokens. Você pode até gerar ações motoras condicionadas a comandos de texto, mas a retroalimentação sensório-motora real falta. Isso não é um bug de implementação; é uma limitação fundamental da abordagem.

Operadores sabem que fine-tuning com RLHF dá a ilusão de compreensão, mas a base continua sendo estatística. O modelo não 'entende' o que é um objeto – ele prevê o próximo token com base em padrões de treinamento. Se você pedir para um LLM descrever como amarrar um cadarço, ele pode gerar uma explicação perfeita. Mas coloque um robô para executar a ação no mundo real: ele tropeça nos loops de feedback, na imprevisibilidade tátil, na necessidade de calibrar força e ângulo. A multimodalidade expande o contexto de entrada, mas não resolve o problema do grounding – a conexão entre símbolos e realidade física.

O que isso muda na prática

Para quem desenvolve agentes de IA, a implicação é direta: não espere que um modelo multimodal, por si só, entregue AGI. Você precisa de um pipeline que inclua simulação física, aprendizado por reforço com interação real, ou pelo menos um modelo de mundo baseado em dinâmica causal. Empresas que investem apenas em scale-up de dados e parâmetros podem estar no caminho errado. Por outro lado, startups focadas em robótica com modelos que aprendem por experiência – como aquelas que usam técnicas de imitation learning com demonstrações humanas – têm uma vantagem competitiva. Na prática, você deve ajustar suas expectativas de roadmap: não planeje uma AGI baseada em texto em 3 anos. Em vez disso, invista em loops de coleta de dados físicos, em sensores mais baratos, em ambientes de simulação realistas (tipo Isaac Sim da NVIDIA). A ação concreta agora é revisar a estratégia de P&D: pare de tratar o problema de grounding como algo que o scale resolverá. Ele exige mudança de paradigma.

Tensão: o custo compensa?

A reflexão incômoda aqui é: mesmo que a compreensão incorporada seja essencial, construir sistemas que a adquiram é caro, lento e arriscado. Robôs físicos quebram, simulações têm lacunas de realismo, dados de interação são escassos. Talvez o caminho mais rápido para AGI não seja replicar o corpo humano, mas encontrar um atalho que combine linguagem, raciocínio abstrato e um modelo de mundo aproximado. O artigo do Gradient não oferece uma solução – só aponta o problema. Fica a pergunta: o custo de incorporar o corpo vale o ganho? Ou vamos terminar com uma AGI que 'entende' tudo sobre o mundo sem nunca ter tocado nele, como um erudito que nunca saiu de casa? Duvido que isso resolva os problemas reais que exigem interação física.

Conclusão

AGI não será alcançada apenas com mais dados multimodais; a compreensão tácita e incorporada é peça-chave, e os modelos atuais ainda a ignoram. O artigo do Gradient acende um alerta útil para quem está na trincheira. E você, está apostando em scale ou em embodiment? O debate continua.

Nenhum comentário ainda. Seja o primeiro a comentar!

Deixe seu comentário